Rédaction

Date

Le CVPR, rendez-vous incontournable de la vision par ordinateur, a encore une fois offert un aperçu fascinant des avancées technologiques qui façonneront l'avenir de nombreux domaines, y compris la créativité numérique. Deux de nos chercheur·es, Olivier Leclerc et Shaghayegh (Sherry) Taheri, ont eu la chance d'y participer et partagent ici leurs impressions sur les technologies émergentes, leurs découvertes et l’impact potentiel de ces innovations sur les secteurs de la créativité numérique. Découvrez leurs réflexions sur les modèles de diffusion, la génération de données synthétiques, la reconstruction 3D, l'IA créative et leurs recommandations pour l'industrie.

Qu’est-ce qui vous a motivé à participer à CVPR 2024, et quels objectifs spécifiques aviez-vous en tête pour cet événement?

Olivier Leclerc: J’y ai participé l’année dernière et j’ai trouvé cela très inspirant, même si j’ai manqué la première partie (les ateliers). Cette année, je voulais vivre l’expérience complète et me faire une idée de l’ensemble du domaine, pour m’aider à comprendre où la communauté de la vision porte son attention. Je trouve que cela me donne une vue d’ensemble et une inspiration qui durent toute l’année, alors que j’explore de nouvelles idées à intégrer dans mon travail.

Shaghayegh (Sherry) Taheri: J’étais enthousiaste à l’idée de participer à CVPR car c’est une conférence de premier plan en vision par ordinateur où je pouvais en apprendre davantage sur les dernières avancées dans le domaine et me connecter avec des experts de renom (cela peut sembler cliché, mais c’est vrai). Mon objectif principal était d’acquérir des connaissances pratiques qui pourraient être appliquées à nos projets actuels.

Quels ont été les points forts de CVPR 2024 pour vous, et pourquoi les considérez-vous importants pour l’industrie de la créativité numérique?

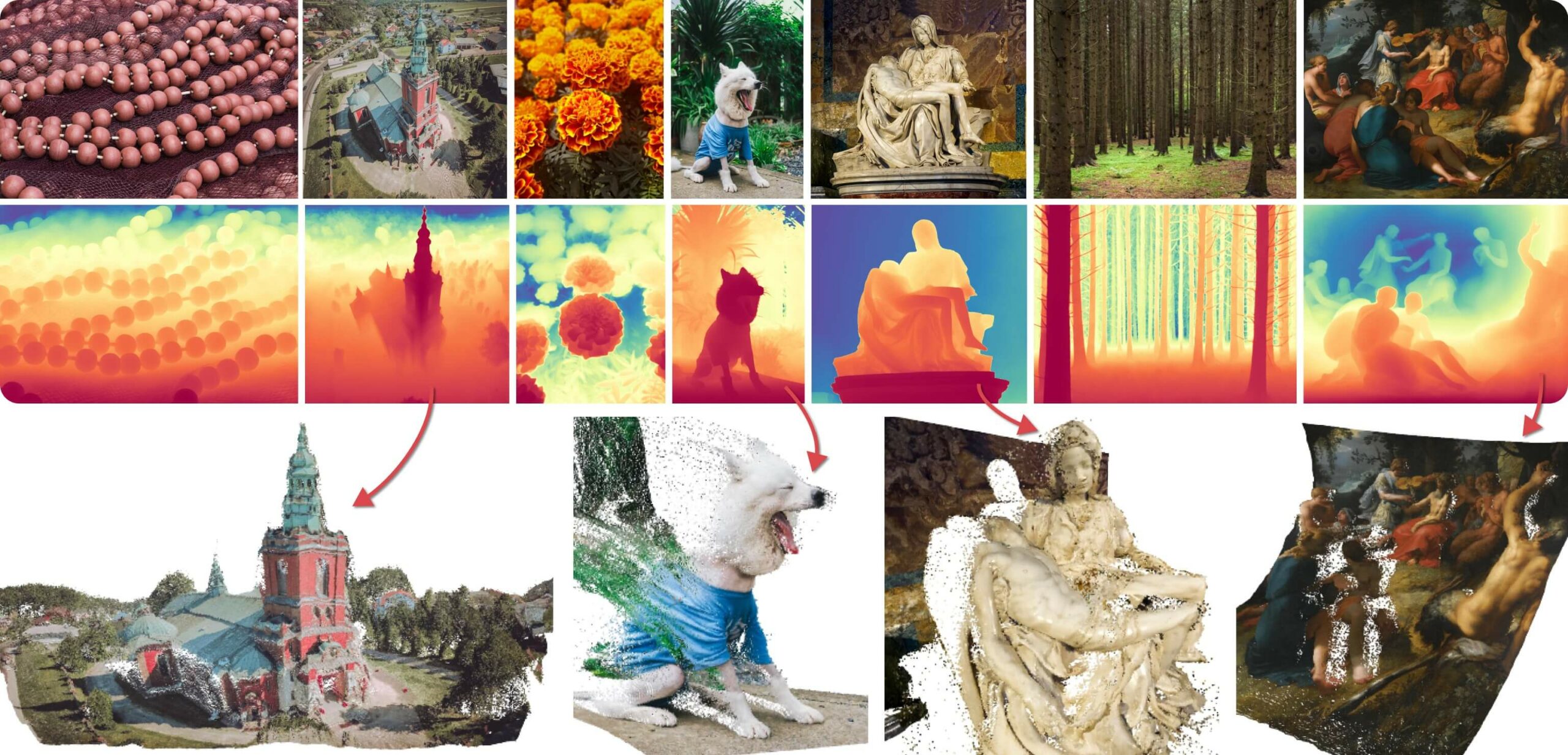

Olivier: Je dois dire que l’étendue des applications des modèles de diffusion m’a surpris. Les expert·es explorent toutes les façons possibles de les utiliser, et cela va bien au-delà de la génération d’images. Par exemple, on peut recréer des parties non visibles lors de la reconstruction 3D pour compenser des images sous-optimales, rendant le processus de photogrammétrie plus indulgent.

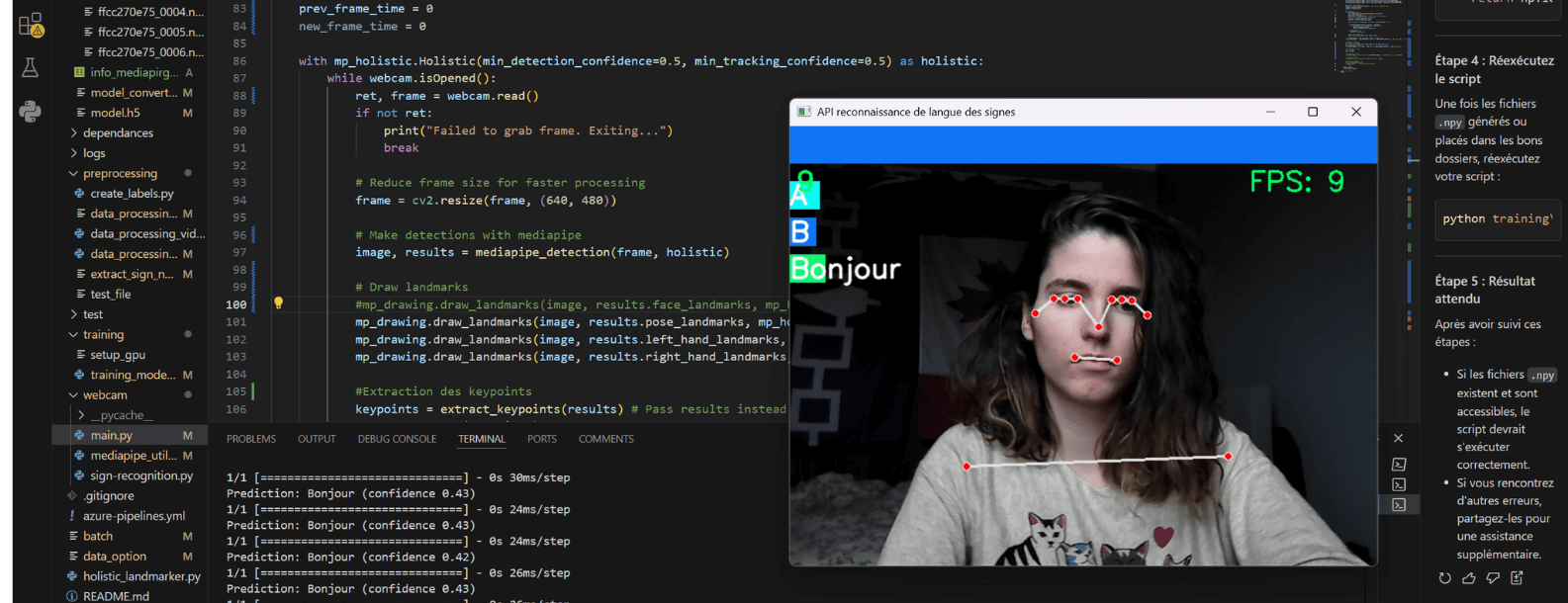

Sherry: J’ai été impressionnée par la diversité de la recherche et les progrès réalisés dans les modèles de diffusion, les modèles vision-langage, la génération de données synthétiques, la génération 3D et l’animation générative. J’ai trouvé particulièrement intéressant de voir la réutilisation innovante des modèles de diffusion. Par exemple, l’article Repurposing Diffusion-Based Image Generators for Monocular Depth Estimation démontre comment les vastes connaissances intégrées dans la diffusion stable peuvent être utilisées pour l’estimation de la profondeur monoculaire. Un autre exemple est la méthode «DiffusionPoser», qui montre la reconstruction du mouvement humain en temps réel à partir de combinaisons arbitraires de capteurs IMU en employant un algorithme de débruitage par inpainting.

Y a-t-il eu des idées ou des tendances inattendues que vous avez découvertes lors de CVPR 2024 et qui, selon vous, influenceront notre industrie?

Olivier: Quelque chose que j’ai appris là-bas, c’est l’ampleur des efforts consacrés à l’interprétation du corps, probablement liée à la tendance VR et métavers. J’ai été surpris que les modèles puissent prédire les mouvements des jambes sans les voir ni avoir de capteur sur eux, simplement en corrélant les mouvements de la tête et des mains avec les comportements humains réels du corps entier. Il y a aussi de grands progrès dans la capture de mouvement sans marqueurs.

Sherry: L’une des conférences les plus intrigantes auxquelles j’ai assisté était N=0: Learning Vision with Zero Visual Data. Elle expliquait comment les modèles LLM, entraînés sur des ensembles de données non visuelles, peuvent faire des jugements sémantiques sur des images sans jamais les avoir vues. L’idée a été explorée plus en détail dans l’article The Platonic Representation Hypothesis. Je pense que la capacité des LLM à comprendre des images sans entraînement visuel direct est fascinante et présente un grand potentiel pour de futures applications.

Quelles technologies ou innovations émergentes présentées à CVPR 2024 auront le plus d’impact sur notre domaine (jeux vidéo, effets visuels, animation et immersion)?

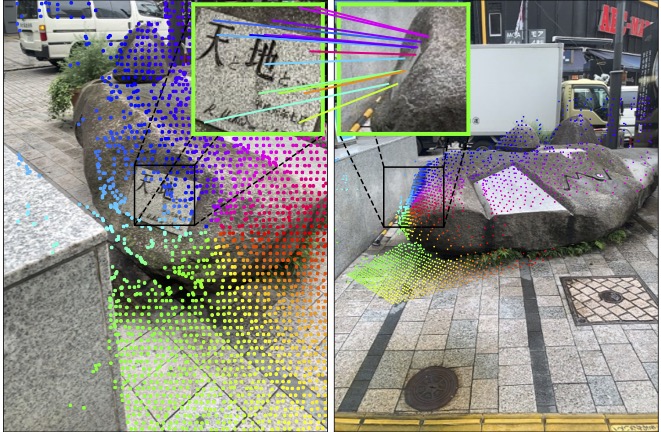

Olivier: Il y a eu des améliorations progressives dans pratiquement tous les domaines. Je me souviens d’un article intitulé SpiderMatch, où on a été capable de réaliser une très bonne correspondance de formes entre les humanoïdes et les animaux. J’ai également vu une démonstration d’une caméra qui effectue du «calcul au niveau du pixel», ce qui permet une réalité augmentée si rapide qu’il n’y a aucun délai perceptible, même avec des mouvements très rapides.

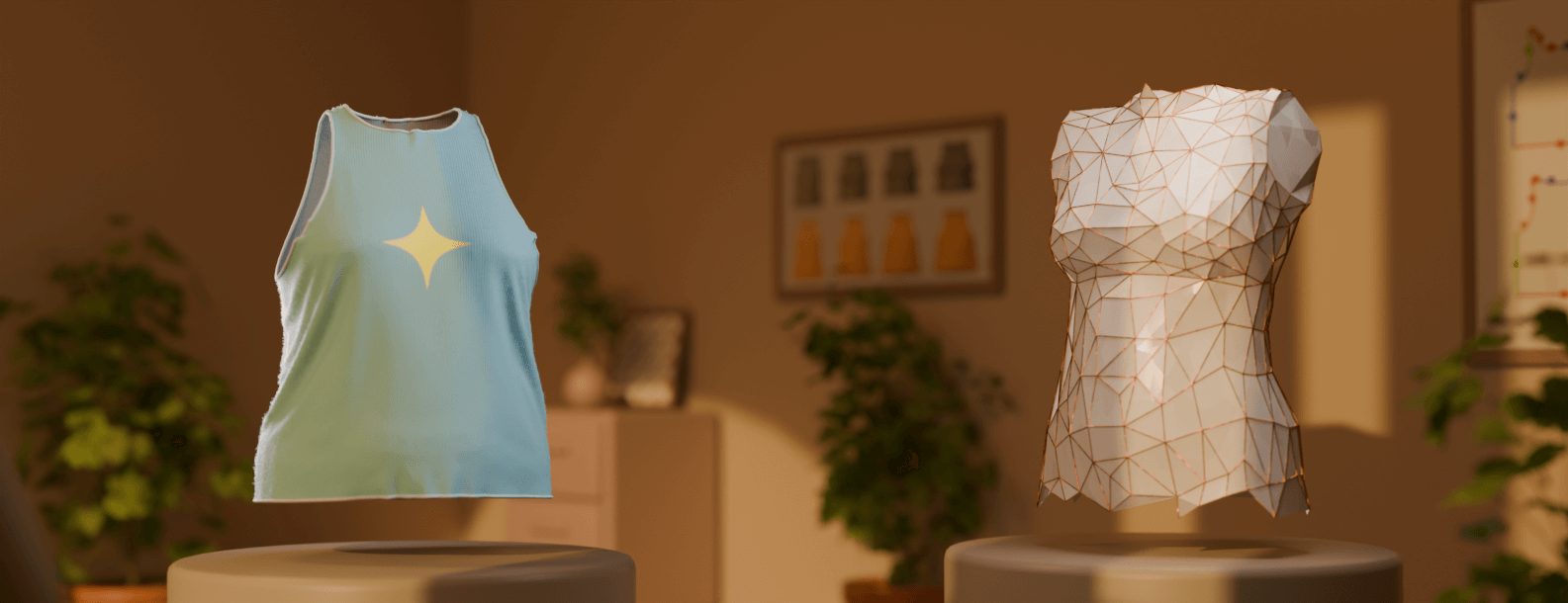

Sherry: Je vois beaucoup de potentiel dans la recherche sur la génération 3D. Bien qu’elle ne soit pas encore prête pour la production, elle s’améliore rapidement. Une fois qu’elle aura atteint la qualité souhaitée, elle aura probablement un impact significatif dans ces domaines.

Comment votre participation à CVPR 2024 a-t-elle influencé votre rôle, et quelles idées prévoyez de tester dans nos projets au CDRIN?

Olivier: Je me suis concentré sur la recherche des meilleures innovations en matière d’estimation de la pose de caméra (une étape préalable aux NeRF et au Gaussian Splatting). J’ai lu l’article DUSt3R/MASt3R et discuté avec les auteurs, et j’ai participé à l’atelier Image Matching Challenge. Il y a d’excellentes contributions dans ce domaine que je suis impatient de mettre en pratique!

Sherry: En plus des excellentes perspectives sur les architectures d’apprentissage profond, la compréhension d’images et de vidéos, l’IA générative, l’apprentissage profond multimodal et les modèles vision-langage, un point clé à retenir était le rôle essentiel des données. Souvent, les données sont encore plus importantes que les modèles d’IA eux-mêmes. Les avancées en matière de génération de données synthétiques et de distillation de jeux de données présentées à CVPR sont particulièrement importantes, et je prévois de les intégrer dans mon travail au CDRIN.

Où se situe notre industrie par rapport aux avancées présentées à CVPR 2024?

Olivier: Je pense qu’il y a beaucoup d’idées utilisables qui fusent dans toutes les directions, et je vois des entreprises proposer de plus en plus de bonnes implémentations au sein de leurs logiciels ou de leurs offres cloud. Ce faisant, elles capturent la valeur et risquent d’obscurcir les progrès futurs. Nous devons rester à jour et nous assurer de comprendre ce qui se passe afin de pouvoir développer ou modifier librement ces technologies pour répondre à nos besoins.

Sherry: La créativité numérique et les avancées issues de conférences comme CVPR sont désormais réellement liées. Les entreprises qui créent des outils numériques publient également des articles de recherche, ce qui montre l’importance de la recherche universitaire pour faire progresser ce domaine. Pour nos stratégies futures, cela signifie que nous devons continuer à nous appuyer sur les dernières recherches de pointe.

Comment envisagez-vous l’impact des technologies émergentes présentées à CVPR sur le paysage plus large de l’intelligence numérique, et quelles mesures devrions-nous prendre pour rester à la pointe dans ce domaine en évolution rapide?

Olivier: Les grands modèles de fondation sont trop coûteux à entraîner pour que nous puissions rivaliser. Cependant, il y a beaucoup de choses que nous pouvons faire, à condition de prendre soin de structurer et de partager stratégiquement nos données. Je pense que la clé réside dans la personnalisation et les petits modèles (edge computing), de même que dans l’utilisation intelligente de modèles plus grands.

Sherry: Je crois que nous devrions continuer à intégrer activement les nouvelles technologies dans nos processus de développement tout en optimisant l’utilisation de nos ressources et en organisant nos données plus efficacement. Je suis particulièrement intéressée par l’exploration de techniques telles que la distillation de données et de modèles. De plus, la collaboration avec d’autres centres de recherche et universités peut nous aider à garder une longueur d’avance.

Vous travaillez en créativité numérique? Voici des pistes à explorer selon nos expert.es:

Les outils d’IA sont en train de révolutionner la créativité numérique sur de nombreux aspects. Utilisez des modèles génératifs 2D comme Stable Diffusion pour la création de contenu haute fidélité. Restez à jour sur tout ce qui touche la génération 3D, un domaine en pleine croissance rapide, y compris sur les méthodes comme le Gaussian splatting. Si votre entreprise est confrontée à une pénurie de données, explorez la génération de données synthétiques. Ce domaine progresse rapidement, avec des modèles génératifs utilisés pour créer de nouveaux ensembles de données. Des exemples lors du CVPR incluent l’utilisation de la génération de mouvement humain pour améliorer les performances des véhicules autonomes dans la détection du comportement des piétons, et le concours de l’atelier SyntaGen sur la création d’ensembles de données de haute qualité pour la segmentation sémantique.

Jetez un coup d’œil au Gaussian splatting (le successeur des NeRF), ils sont de plus en plus faciles à générer en utilisant moins d’images (aussi peu que 2 dans pixelSplat). Il existe également des techniques non supervisées ou d’augmentation de données qui peuvent bien fonctionner avec des données rares pour la détection et la segmentation d’objets. Enfin, si vous travaillez avec des corps humains, il y a beaucoup à voir en termes de capture de mouvement, de détection de pose, de correspondance de formes, de prédiction de mouvement et plus encore.